Автор: Дарья Кравец

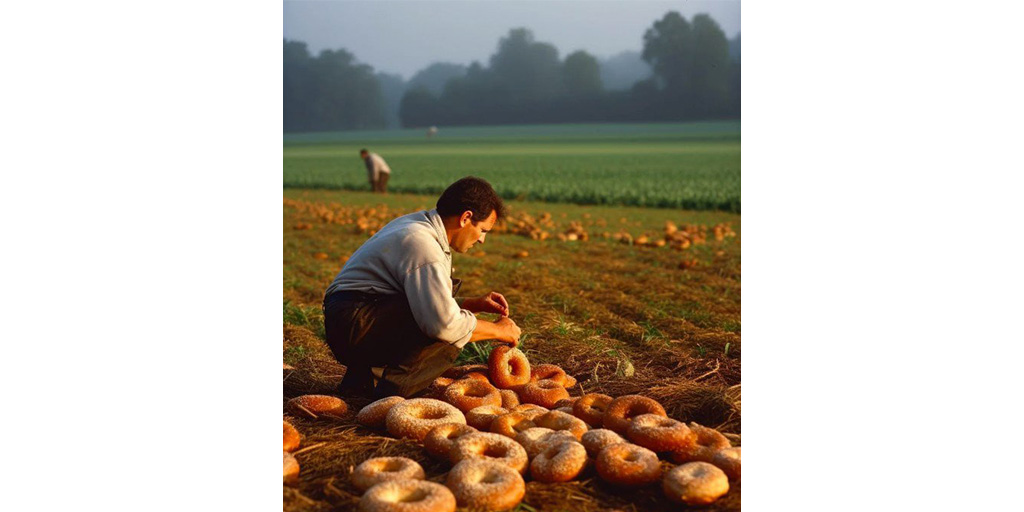

Midjourney — нейросеть, создающая изображения по текстовому описанию. С недавних пор ее использование стало платным — разработчикам не понравилось огромное количество фейков, гуляющих по интернету. Многие картинки вызывали бурную реакцию общественности из-за своей реалистичности.

И действительно, еще в прошлом году ученые университета Роял Холлоуэй провели исследование, где выяснили, что люди уже не всегда могут различить сгенерированное изображение от реального.

Так, в марте 2023 в сети завирусился снимок папы римского Франциска в дутом белом пуховике. Пользователи отреагировали неоднозначно: кто-то стал шутить, а кто-то всерьез задумался об опасности современных технологий.

Параллельно с папой римским в интернете распространилась еще одна серия фото — с задержанием Дональда Трампа. На фоне расследования уголовного дела бывшего президента штатов эти фото вызвали доверие у пользователей. И таких примеров немало — Midjourney успела создать немало фейковых и вирусных «снимков» с другим политическими деятелями и мировыми звездами.

Но все-таки есть несколько ошибок от ИИ, которые помогают отличить реальность от вымысла:

1. Главное, обязательно обращайте внимание на человеческие конечности. ИИ часто размывает или умножает пальцы ног и рук. Например, на снимке папы Римского Midjourney плохо поработала с рукой, держащей стакан (или пакет).

2. С тенями и освещением тоже нередко случаются проблемы — они могут лежать неестественно или отсутствовать вовсе.

3. Чтобы запутать пользователей еще сильнее, нейросеть генерирует размытый фон на снимках — так она не заморачивается с деталями, концентрируя силы на чем-то одном и делая картинку более реалистичной.

4. В основном Midjourney создает снимки в очень высоком разрешении — не всякий профессиональный фотоаппарат способен на такое качество.

5. Несоответствие между содержанием и контекстом: странные человеческие позы, композиция или неправдоподобный сюжет также могут указать на сгенерированное фото.

6. Изображения, созданные Midjourney, могут быть неестественно идеальными — например, с гладкой бездефектной кожей или симметричными лицами.

7. Неоригинальность снимков выдает сгенерированную картинку — ИИ может заимствовать детали с известных картин или популярных фотографий.

8. Шаблонность. Если это серия фото, то сразу бросится в глаза их схожесть (как с арестом Дональда Трампа) — похожие выражения лица и движения, одинаковые цвета снимка.

9. Если изображение содержит текст, то стоит рассмотреть его более детально — часто буквы генерируются разного размера, а то и стиля, шрифт может быть неравномерным.

10. Midjourney может неправильно сгенерировать пропорции человека — руки могут быть слишком длинные, а ноги, наоборот, — чересчур короткие.

11. Неестественные сочетания цветов или ярко выраженные контуры объектов помогут отличить настоящее изображение от фейкового. Например, нейросеть может сгенерировать ненатурального цвета траву, странный цвет лица или глаз.

12. И, конечно, детали снимка. Например, нейросеть часто «спотыкается» на глазах — они могут смотреть в разные стороны или выглядеть неживыми. Проблемы возникают и с генерацией брендов — человек может стоять в одежде без логотипов, а устройства известных фирм часто генерируются некорректно.

13. Доверяйте чутью — фото, сгенерированные ИИ, могут пугать без явной на то причины. Иногда вы можете подсознательно понять, что картинка ненастоящая.

Вместе с совершенствованием ИИ появляются и обратные инструменты, помогающие разобраться в реальности картинки. Одна из таких — Google Reverse Image Search, способная найти первоисточник снимка. Если сомневаетесь в картинке, обращайтесь к ним!

Иллюстрации сгенерированы нейросетью